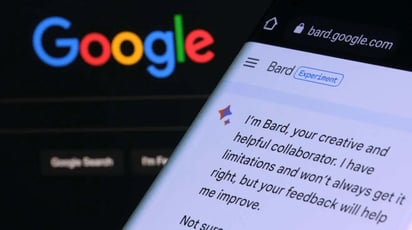

Google recomienda a sus empleados no usar su propio chatbot, Bard

Google sigue refinando las respuestas de su chatbot, Bard. Sin embargo, una cosa es que responda bien, y otra que sea recomendable desde el punto de vista de la seguridad. De hecho, la compañía recomienda a sus empleados ser muy cautos a la hora de usar este tipo de modelos de lenguaje.

Fuentes internas de Alphabet han explicado a Reuters que la compañía ha recomendado a sus empleados no introducir ningún tipo de información confidencial en chatbots, sea el popular ChatGPT, GPT-4 o incluso su propio chatbot debido al riesgo de filtraciones de información. Al parecer, en Alphabet están preocupados por la posibilidad de que sus empleados introduzcan datos sensibles o confidenciales en estas herramientas de IA. De momento Google no ha respondido a la petición de Gizmodo de comentar más sobre este asunto.

La razón de esto es bastante evidente, y es que la mayor parte de chatbots tienen detrás a revisores muy humanos que chequean los datos que introducimos en ellos para ayudar al modelo de lenguaje a refinar sus respuestas. La presencia de estos técnicos puede traducirse en filtraciones, y de hecho no es la primera vez que ocurre. Samsung confirmó el mes pasado que había sufrido filtraciones de datos confidenciales después de que su personal usara ChatGPT.

En enero de este mismo año fue un abogado de Amazon el que instó a su personal a no compartir código con ChatGPT. Capturas de pantalla de Slack reveladas a Insider revelaron que el letrado solicitó a los trabajadores no compartir con el chatbot información confidencial, y tampoco ningún código de programación con el que estuvieran trabajando.

El mes pasado Apple también remitió un aviso similar a sus trabajadores según revelaron documentos internos de la compañía filtrados al Wall Street Journal. Los de Cupertino fueron un paso más allá y prohibieron expresamente usar tanto ChatGPT como la herramienta Copilot de Microsoft que facilita escribir código en Github. En la misma filtración se supo que Apple está interesada en desarrollar su propio modelo de lenguaje, razón por la que ya ha comprado dos empresas jóvenes de IA por 200 y 50 millones de dólares.

Únete al canal de difusión de WhatsApp de El Tiempo MX y recibe las noticias más importantes de Monclova, Coahuila y México directamente en tu celular. ¡Haz clic y súmate ahora!

Noticias del tema